Testa AI på DIN webbplats på 60 sekunder

Se hur vår AI omedelbart analyserar din webbplats och skapar en personlig chatbot - utan registrering. Ange bara din URL och se hur det fungerar!

Evolutionen och effekten av Conversational AI

Conversational AI har utvecklats dramatiskt under det senaste decenniet, och förvandlats från enkla regelbaserade chatbots till sofistikerade system som kan nyansera interaktioner i flera sammanhang. Från kundtjänstapplikationer till verktyg för mental hälsa, röstassistenter till innehållsskapande motorer, dessa teknologier har blivit djupt integrerade i våra personliga och professionella sfärer.

Denna snabba adoption för med sig djupgående etiska överväganden som utvecklare, företag och samhället måste ta itu med. Som någon som har konsulterat om AI-implementeringsprojekt inom olika branscher, har jag bevittnat hur etiska tillsyn under designfasen kan leda till problematiska resultat när dessa system når användarna. Den här bloggen utforskar de etiska dimensioner vi måste tänka på när vi skapar konversations-AI-system som verkligen tjänar mänskligheten.

Sekretess och datahantering: Respektera användargränser

Sekretesshänsyn i konversations-AI måste sträcka sig utöver grundläggande efterlevnad av bestämmelser som GDPR eller CCPA. De bör återspegla en grundläggande respekt för användarnas gränser och förväntningar, särskilt när dessa system är utformade för att framkalla personlig information. Viktiga överväganden inkluderar:

Transparenta datainsamlingsmetoder: Användare förtjänar att veta exakt vilken information som samlas in, hur länge den kommer att lagras och hur den kommer att användas – allt förklarat på ett tillgängligt språk, inte på juridisk jargong.

Meningsfulla samtyckesmekanismer: Samtycke bör vara aktivt, informerat och detaljerat. Användare bör kunna välja in eller stänga av specifika dataanvändningar utan att förlora åtkomst till kärnfunktioner.

Dataminimeringsprinciper: System bör bara samla in det som är nödvändigt för att tillhandahålla den tjänst som användarna förväntar sig, snarare än att samla in ytterligare data som kan vara värdefulla för företaget men irrelevanta för användarens omedelbara behov.

Säker hanteringsmetoder: Robust kryptering, åtkomstkontroller och regelbundna säkerhetsrevisioner bör vara standardpraxis, med särskild uppmärksamhet på känsliga konversationer.

De mest etiska konversations-AI-systemen är de som utformats med integritet som ett grundläggande värde snarare än en kryssruta för efterlevnad – där skydd av användarinformation ses som en kärnfunktion snarare än en begränsning att kringgå.

Ta itu med partiskhet och rättvisa i AI-konversationer

Fördomar i konversations-AI kan visa sig på flera sätt:

Representationsbias: När vissa demografier är överrepresenterade eller underrepresenterade i träningsdata

Interaktionsbias: När systemet reagerar olika på användare baserat på upplevda identitetsegenskaper

Resultatbias: När systemet ger olika resultat för olika användargrupper

Att ta itu med dessa fördomar kräver avsiktlig ansträngning under hela utvecklingens livscykel:

För det första måste utbildningsdata kritiskt utvärderas och balanseras, med särskild uppmärksamhet på att inkludera olika perspektiv och erfarenheter. Detta innebär att man går längre än standarddatauppsättningar för att inkludera röster som annars skulle kunna marginaliseras.

För det andra måste pågående tester inkludera olika användargrupper och övervaka olika prestanda. Det här handlar inte bara om att testa med olika demografiska grupper, utan också att ta hänsyn till olika sammanhang, förmågor och interaktionsstilar.

För det tredje måste designteamen själva inkludera personer med olika bakgrunder och perspektiv som kan identifiera potentiella partiska problem som homogena team kan missa.

Slutligen behöver system kontinuerlig övervakning och uppdatering i takt med att samhälleliga normer utvecklas och nya fördomar identifieras. De mest etiska konversations-AI-systemen är inte bara rättvisa vid lanseringen – de är designade för att bli alltmer rättvisa över tiden.

Transparens och förklaring: Rätten att förstå

Transparens i konversations-AI omfattar flera dimensioner:

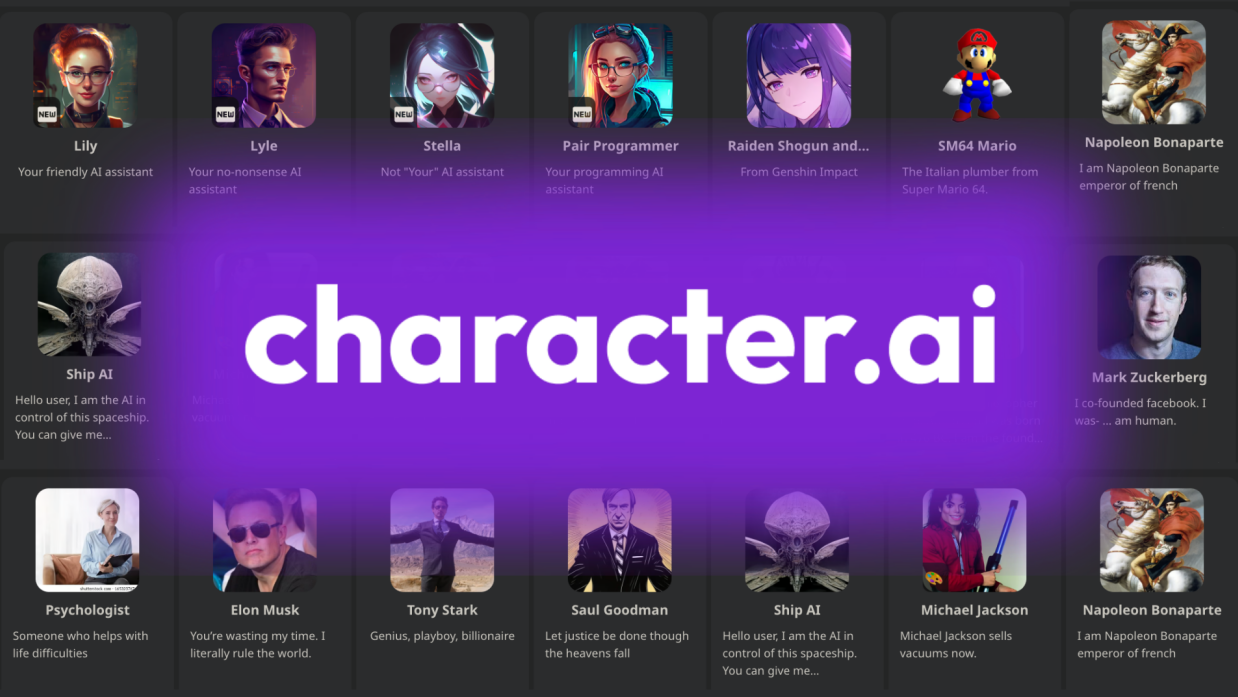

Avslöjande av AI-identitet: Användare bör veta när de interagerar med en AI snarare än en människa. Bedrägliga metoder som medvetet suddar ut denna gräns kränker användarens autonomi.

Processtransparens: Användare förtjänar att förstå hur deras input påverkar systemets resultat, särskilt för beslut med hög insats som godkännanden av lån, medicinska rekommendationer eller resursallokering.

Begränsningstransparens: System bör vara raka om sina möjligheter och begränsningar, snarare än att projicera falsk säkerhet eller expertis.

Förklaringsmöjligheter: När det är lämpligt bör systemen kunna förklara sina rekommendationer eller beslut i termer som användarna kan förstå.

Utöver dessa specifika metoder finns det en bredare filosofisk fråga om nivån på öppenhet användarna förtjänar. Även om fullständig algoritmisk transparens kanske inte alltid är genomförbar eller nödvändig, bör användare ha tillgång till meningsfulla förklaringar som är lämpliga för sammanhanget och konsekvensen av interaktionen.

De mest etiska konversations-AI-systemen är de som ger användarna förståelse snarare än att be om blindt förtroende.

Användarautonomi och kontroll: Designing for Human Agency

Att respektera användarens autonomi i konversations-AI-design innebär att skapa system som:

Respektera explicita gränser: När en användare säger "nej" eller indikerar att de vill avsluta en konversation, bör systemet respektera det utan manipulativ uthållighet.

Ge meningsfulla val: Användare bör ha genuina alternativ, inte tillverkade val som alla leder till samma resultat.

Tillåt korrigering: När ett system missförstår eller gör ett misstag behöver användarna enkla sätt att omdirigera det.

Aktivera anpassning: Användare bör kunna forma interaktionsstilen och parametrarna så att de passar deras preferenser och behov.

Upprätthåll mänsklig tillsyn: För följdbeslut bör det finnas tillgängliga vägar till mänsklig granskning.

Spänningen mellan design för effektivitet och respekt för användarnas autonomi är särskilt tydlig i övertygande applikationer som försäljning eller beteendeförändringssystem. Etiska linjer suddas ut när konversations-AI använder psykologisk taktik för att påverka användarnas beslut – även när det avsedda resultatet kan gynna användaren.

De mest etiska konversations-AI-systemen har en tydlig preferens för användarkontroll över systembekvämlighet eller affärsmål.

Testa AI på DIN webbplats på 60 sekunder

Se hur vår AI omedelbart analyserar din webbplats och skapar en personlig chatbot - utan registrering. Ange bara din URL och se hur det fungerar!

Tillgänglighet och inkludering: Design för alla

Verkligt etisk konversations-AI måste vara tillgänglig för människor med olika förmågor, språk, kulturella referenser och tekniska färdigheter. Detta betyder:

Stöd för flera inmatningsmetoder: Text, röst och andra modaliteter bör vara tillgängliga för att tillgodose olika behov och preferenser.

Anpassning till olika kommunikationsstilar: System bör hantera variationer i språkanvändning, inklusive accenter, dialekter och okonventionell syntax.

Tillhandahålla lämpliga alternativ: När en användare kämpar med AI-gränssnittet bör tydliga vägar till alternativt stöd finnas tillgängliga.

Kulturell känslighet: System bör känna igen och respektera kulturella skillnader i kommunikationsmönster och förväntningar.

Tillgänglighet är inte bara en teknisk utmaning – det är ett grundläggande etiskt övervägande som avgör vem som drar nytta av dessa tekniker och vem som blir kvar. När konversations-AI främst är designad för användare som matchar utvecklarnas profiler skapar det oundvikligen digitala klyftor som förstärker befintliga ojämlikheter.

De mest etiska konversations-AI-systemen är de som är utformade med det uttryckliga målet att betjäna olika befolkningsgrupper, inte bara de enklaste eller mest lönsamma användarsegmenten.

Att undvika exploatering och manipulation: Bygga förtroende

Etiska överväganden kring manipulation och utnyttjande inkluderar:

Emotionell manipulation: System bör inte utnyttja mänskliga tendenser att antropomorfisera eller bilda anknytning till AI, särskilt när dessa kopplingar tjänar kommersiella intressen.

Mörka mönster: Konversationsflöden bör inte utformas för att förvirra användare att göra val de annars inte skulle göra.

Sårbarhetsmedvetenhet: System bör känna igen och ta emot användare som kan vara särskilt mottagliga för påverkan, inklusive barn, människor i kris eller de med kognitiva funktionsnedsättningar.

Kommersiell transparens: När konversations-AI tjänar kommersiella syften bör dessa motiveringar vara tydliga snarare än förklädda som hjälpsamhet eller omsorg.

Gränsen mellan hjälpsam övertalning och oetisk manipulation är inte alltid tydlig. En mentalvårdsassistent som uppmuntrar konsekvent engagemang kan verkligen tjäna användarens intressen, medan ett identiskt interaktionsmönster som säljer prenumerationsuppgraderingar väcker etiska problem.

De mest etiska konversations-AI-systemen upprätthåller ärliga relationer med användare och prioriterar genuin assistans framför tillverkat engagemang eller strategiskt utnyttjande av mänsklig psykologi.

Ansvar och ansvar: När AI går fel

I takt med att konversations-AI-system tar på sig allt viktigare roller, blir ansvarsfrågor mer brådskande:

Tydligt ägande av resultaten: Organisationer som använder AI-system måste ta ansvar för deras effekter, snarare än att avleda skulden till teknik, användare eller tredjepartsutvecklare.

Lämpliga ramar för ansvar: Rättsliga och regulatoriska strukturer måste utvecklas för att hantera skada orsakad av AI-system, särskilt i högriskdomäner.

Tillgängliga rättelsemekanismer: Användare som drabbas av AI-fel eller skada behöver tydliga, tillgängliga sätt att söka lösning.

Kontinuerlig övervakning och förbättring: Organisationer har en etisk skyldighet att aktivt övervaka för oavsiktliga konsekvenser och ta itu med problem proaktivt.

Utmaningarna med tillskrivning i komplexa AI-system gör ansvarsskyldighet komplicerad men inte mindre viktig. När flera parter bidrar till ett system – från dataleverantörer till modellutvecklare till driftsättningsorganisationer – kan ansvaret bli spritt, vilket lämnar användarna utan tydliga tillvägagångssätt när saker går fel.

De mest etiska AI-implementeringarna för konversation inkluderar robusta ramverk för ansvarsskyldighet som säkerställer att någon svarar när användare frågar: "Vem är ansvarig för detta?"

Praktiska ramar för etisk AI-design

Praktiska tillvägagångssätt för etisk AI-design inkluderar:

Värdekänsliga designmetoder: Att explicit identifiera kärnvärden tidigt i utvecklingsprocessen och spåra deras implementering genom tekniska val.

Olika intressenternas engagemang: Inkluderar inte bara tekniska experter utan etiker, domänspecialister och – avgörande – representanter från användargemenskaper, särskilt de som sannolikt kommer att påverkas negativt.

Etiska riskbedömningar: Systematiskt identifiera potentiella skador och fördelar mellan olika användargrupper före implementering.

Etappvis distributionsstrategier: Gradvis införande av system i begränsade sammanhang med noggrann övervakning innan bredare utgivning.

Oberoende etisk granskning: Söker extern utvärdering från individer eller organ utan ekonomiskt intresse i projektet.

Etikutbildning för utvecklingsteam: Bygga etisk läskunnighet bland tekniska team för att hjälpa dem att känna igen och ta itu med etiska dimensioner av tekniska beslut.

Dessa ramverk handlar inte bara om att undvika skada – de handlar om att avsiktligt skapa konversations-AI som positivt bidrar till individuellt välbefinnande och socialt välmående.

De mest framgångsrika implementeringarna jag har sett är de där etik inte ses som ett hinder för innovation utan som en avgörande dimension för att skapa verkligt värdefulla och hållbara AI-system.

Slutsats: Vägen framåt

Den mest etiska vägen framåt handlar inte om att tillämpa stela regler eller införa allmänna begränsningar. Det handlar snarare om att utveckla genomtänkta processer som centrerar mänskliga värderingar, erkänner olika behov och upprätthåller mänsklig handlingsfrihet under utvecklingen och driftsättningen av dessa allt kraftfullare system.

Som användare, utvecklare, tillsynsmyndigheter och medborgare har vi alla roller att spela för att säkerställa att konversations-AI utvecklas på sätt som förbättrar snarare än minskar mänsklig autonomi, rättvisa och välbefinnande. Frågorna som tas upp i den här artikeln har inga enkla svar, men genom att engagera oss ärligt och kontinuerligt kan vi arbeta mot AI-system som förtjänar vårt förtroende genom deras bevisade engagemang för etiska principer.

De konversations-AI-system som är mest värda vår uppmärksamhet och adoption kommer att vara de som är utformade inte bara för teknisk excellens utan också för etisk excellens.