Testa AI på DIN webbplats på 60 sekunder

Se hur vår AI omedelbart analyserar din webbplats och skapar en personlig chatbot - utan registrering. Ange bara din URL och se hur det fungerar!

1. Inledning: Uppkomsten av AI och dess expanderande gränser

Men var ska vi dra gränsen? När AI blir mer autonom, växer de etiska, juridiska och samhälleliga konsekvenserna. Den här bloggen utforskar gränserna för AI, dess risker och hur vi kan balansera innovation med etiskt ansvar.

2. AI:s förmåga: Hur långt har vi kommit?

1. AI i automation och beslutsfattande

AI-drivna system automatiserar kundservice, HR-processer och finansiella transaktioner.

Prediktiv analys hjälper företag att förutsäga trender och optimera verksamheten.

AI-algoritmer fattar beslut i realtid inom hälsovård, cybersäkerhet och aktiehandel.

2. Generativ AI och kreativitet

AI skapar konst, musik och skrivet innehåll, och suddar ut gränserna mellan människans och maskinens kreativitet.

AI-drivna designverktyg genererar logotyper, marknadsföringsinnehåll och till och med filmmanus.

AI-modeller hjälper till med vetenskaplig forskning, skriva kod och förbättra innovation.

3. AI i autonoma system

Självkörande fordon använder AI för realtidsnavigering och objektdetektering.

AI-drivna robotar används i tillverkning, rymdutforskning och militära tillämpningar.

AI-drivna drönare och övervakningssystem övervakar säkerhet och logistikverksamhet.

3. De etiska gränserna för AI: Var drar vi gränsen?

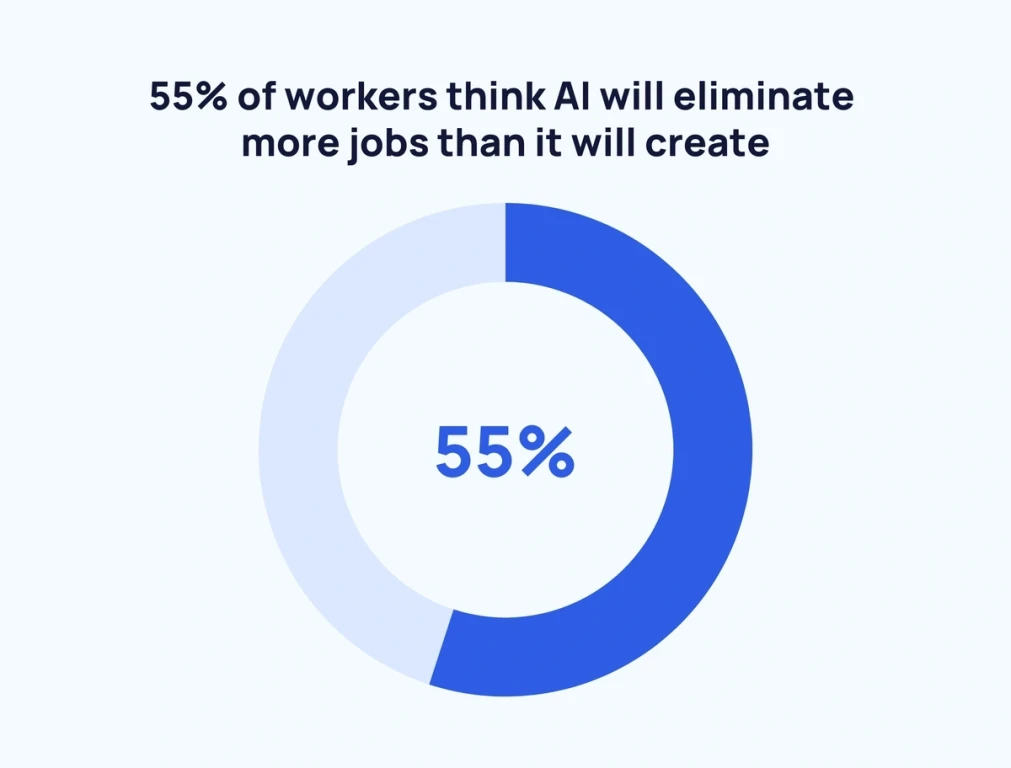

1. AI och jobbförskjutning: När går automatiseringen för långt?

AI ersätter jobb inom kundservice, tillverkning och dataanalys.

Medan AI ökar effektiviteten kan massautomatisering leda till ekonomisk ojämlikhet och förlust av arbetstillfällen.

Regeringar och företag måste investera i AI-ombildningsprogram för att balansera automatisering med sysselsättningsmöjligheter.

2. AI-bias och rättvisa: Kan AI fatta opartiska beslut?

AI-system kan ärva fördomar från träningsdata, vilket leder till orättvisa resultat.

Partisk AI har påverkat anställningsbeslut, straffrättsliga algoritmer och utlåningsgodkännanden.

AI-etiska ramverk måste säkerställa rättvisa, ansvarsskyldighet och begränsning av partiskhet i AI-modeller.

3. AI i övervakning och integritet: Hur mycket är för mycket?

AI-drivna övervakningsverktyg spårar individer, analyserar beteenden och förutsäger brottsmönster.

Ansiktsigenkänning AI används av regeringar för brottsbekämpning och säkerhetsövervakning.

Gränsen mellan säkerhet och integritet måste vara tydligt definierad genom strikt AI-styrning och regelverk.

4. AI i krigföring och autonoma vapen

Militära AI-system kan identifiera och rikta in sig på hot autonomt.

Användningen av AI i krigföring väcker moraliska farhågor om ansvarighet och oavsiktlig eskalering.

Internationella avtal måste reglera utplaceringen av AI i militära tillämpningar.

5. AI och Deepfake Manipulation

AI-genererade deepfakes kan sprida desinformation, imitera individer och manipulera den allmänna opinionen.

AI-driven mediemanipulation hotar demokratiska institutioner och personliga rykten.

Regeringar måste införa strikta regler för AI-genererat innehåll för att bekämpa deepfake missbruk.

4. De juridiska och reglerande gränserna för AI

1. Globala AI-föreskrifter och styrning

EU AI Act syftar till att reglera AI-användning baserat på riskkategorier.

U.S. AI Bill of Rights beskriver etiska AI-utvecklingsprinciper.

Länder inför datasekretesslagar (GDPR, CCPA) för att reglera AI:s tillgång till personuppgifter.

2. AI-etik och företagsansvar

Företag som Google, Microsoft och OpenAI fastställer interna AI-etiska policyer.

AI-transparens är avgörande för att säkerställa ansvarsskyldighet och förhindra skadliga AI-tillämpningar.

Företag måste etablera AI-styrningsteam för att övervaka etisk AI-implementering.

3. Definiera AI:s roll i samhället

Bör AI tillåtas att fatta livsförändrande beslut inom sjukvård, finans och straffrätt?

Hur mycket kontroll ska människor ha över AI-beslutsfattande och autonomi?

Tydliga policyer måste definiera var AI ska hjälpa kontra där mänsklig tillsyn krävs.

5. Att hitta en balans: Hur man säkerställer ansvarsfull AI-utveckling

1. Etisk AI-design och förklaring

AI-utvecklare måste prioritera förklarlig AI (XAI) för att göra AI-beslut transparenta.

Etiska AI-principer bör innefatta ansvarighet, rättvisa och icke-diskriminering.

2. Human-AI-samarbete istället för full automatisering

AI bör förbättra mänskliga förmågor snarare än att helt ersätta mänskliga arbetare.

Företag bör implementera AI som ett samarbetsverktyg, vilket säkerställer mänsklig tillsyn i kritiska beslut.

3. Starka AI-regler och globalt samarbete

Regeringar måste införa lagar som förhindrar AI-missbruk samtidigt som de främjar innovation.

AI-säkerhetsforskning bör finansieras för att utforska långsiktiga risker och begränsningsstrategier.

4. AI-utbildning och arbetskraftsanpassning

AI-fokuserade utbildnings- och omskolingsprogram bör förbereda arbetare för AI-förstärkta karriärer.

Företag måste investera i AI-läskunnighet och etikutbildning för anställda och intressenter.

6. Slutsats: Framtiden för AI och etiska gränser

Framtiden för AI beror på var vi drar gränsen – att balansera innovation med etik, automatisering med anställning och säkerhet med integritet. Nyckeln är ansvarsfull AI-utveckling som prioriterar mänskligt välbefinnande, rättvisa och långsiktig hållbarhet.

När AI utvecklas kvarstår den ultimata frågan: hur säkerställer vi att AI tjänar mänskligheten utan att överskrida etiska och samhälleliga gränser?